2019-11-19 17:18:52

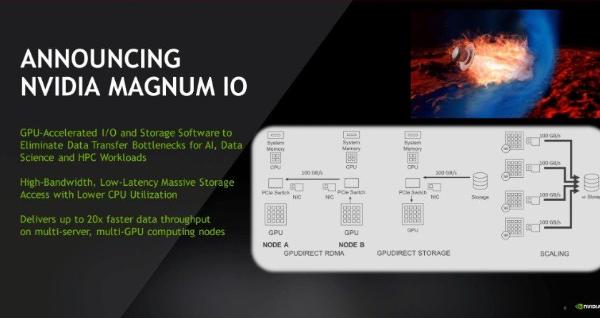

NVIDIA在SC19宣布与DataDirect Networks、 Excelero、 IBM、 Mellanox 、 WekaIO共同开发一套专为加速大量数据处理的软体,名为NVIDIA Magnum IO ,这项软体技术透过最佳化方式,使跨多主机、多GPU等环境提升海量数据处理速度,对于像是财务分析、气候模型一类的大量数据处理,最高可提升20倍数据处理速度。

Magnum IO的核心是建构在GPUDirect之上,可使位于储存上的数据不须经过CPU就直接进入GPU ,省却繁杂的多次传送,达到加速海量数据传输的性能; GPUDirect透过点对点与RDMA构成,能够在包括NVIDIA NVLink和NCCL以及OpenMPI和UCX等连接技术与API使用。

NVIDIA 也预计在2020 年推出针对储存设备直接连接GPU 的GPUDirect Storage ,这项技术可使储存内的资料同样绕过CPU ,直接传输到GPU ,对模拟、分析、可视化等应用可望达到显著的提升。

NVIDIA Magnum IO软体已经正式推出,并提供给早期客户进行试用,预计在2020年追加针对储存直连的GPUDirect Storage 。